近日,实验室在高效视觉感知领域取得重要进展。由实验室博士生胡杰、曹刘娟教授(通讯作者)、硕士生金晓峰、张声传副教授、纪荣嵘教授合作完成的论文 “Universal Image Segmentation with Efficiency” 被国际学术期刊《IEEE Transactions on Pattern Analysis and Machine Intelligence》(IEEE TPAMI)正式录用。TPAMI是计算机学科领域最顶级的国际期刊,影响因子18.6。

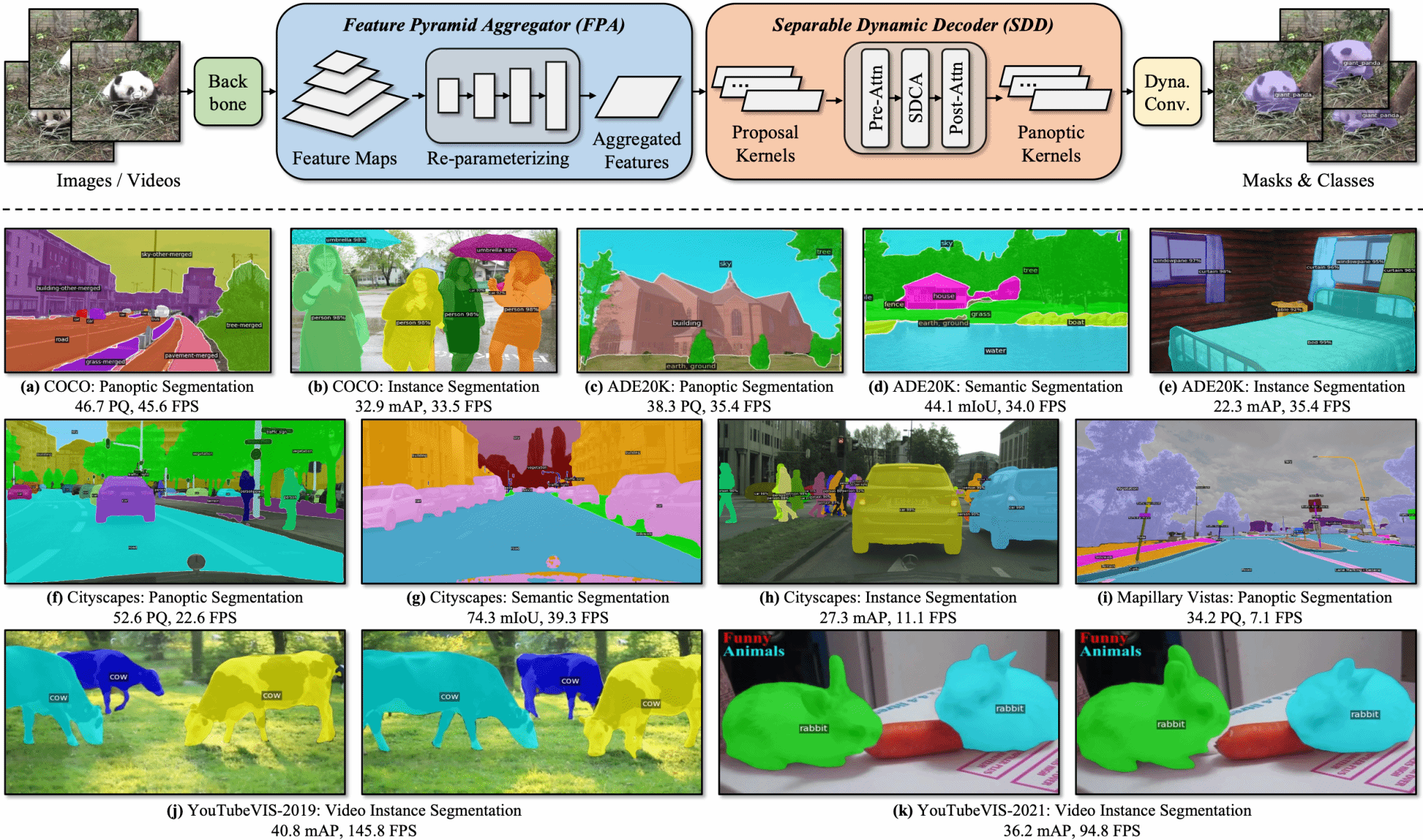

论文提出了一种面向多任务的高效通用图像分割框架,旨在通过一个统一模型完成全景、实例、语义以及视频分割任务。该方法基于动态卷积核机制,将不同分割任务统一建模为“卷积核与图像特征图之间的动态卷积”,避免了为每种任务设计独立网络结构的复杂性。

其技术核心包括两个关键模块:

1. 特征金字塔聚合器:支持训练与推理阶段的重参数化。具体而言,模型在训练阶段采用“插值优先”的结构以保证特征融合的精度,而在推理阶段则通过数学等价变换将其重参数化为“卷积优先”结构,在大幅度降低计算量的同时(模型FLOPs减少约 7.9 倍),无需重新训练,也不损失模型精度。

2. 可分离动态解码器:通过引入深度可分离的一维卷积操作,近似实现传统 Transformer 中的多头交叉注意力机制。该设计在保留全局建模能力的同时,显著降低了计算复杂度与 GPU 延迟(模型推理延迟降低约 1.4 倍),进一步提升了模型的实时性。

文章在多个主流分割数据集上进行了实验,对比了领域内70+篇文章100+个模型,结果表明该框架在 COCO、ADE20K、Cityscapes、Mapillary 以及 YouTube-VIS 等任务中均取得了与当前专用模型相当甚至更优的性能指标(如 PQ、AP、mIoU),同时推理速度显著提升。本研究为构建实时、通用的图像分割系统提供了新的技术路径和性能基线,体现了团队在高效视觉感知领域的前沿研究实力和国际学术影响力。